En la era de la innovación tecnológica, la Inteligencia Artificial (IA) se ha convertido en una herramienta omnipresente en nuestra vida diaria. Desde sistemas de recomendación en plataformas de streaming hasta algoritmos de predicción en la medicina, la IA ha demostrado un potencial sin límites para mejorar la eficiencia y la comodidad en diversos aspectos de nuestras vidas. Sin embargo, junto con sus beneficios, también surge una pregunta inquietante: ¿Se está saliendo de control la Inteligencia Artificial?

Indudablemente, la IA tiene un enorme potencial para mejorar nuestras vidas en múltiples aspectos. Desde la automatización de tareas repetitivas hasta el desarrollo de sistemas de conducción autónoma que prometen revolucionar el transporte, la IA ha sido aclamada como la clave para resolver algunos de los desafíos más apremiantes de nuestra industria. Sin embargo, en medio de este entusiasmo, surgen preocupaciones legítimas sobre su uso ético y las posibles consecuencias no deseadas.

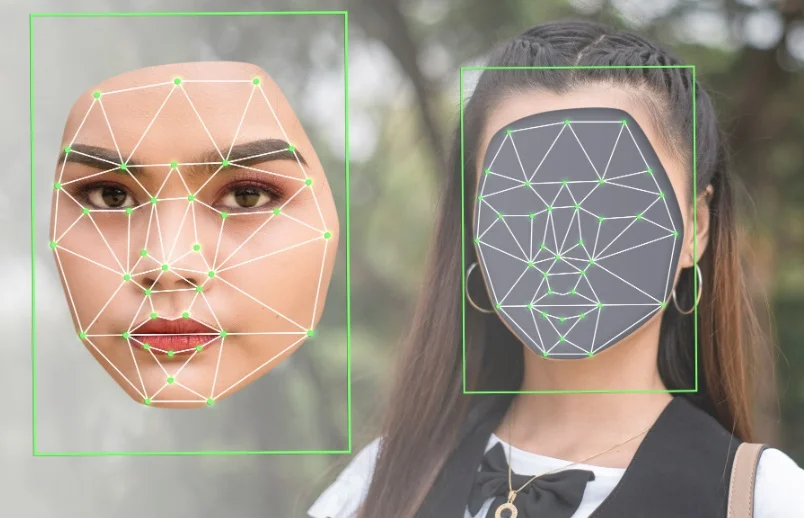

Un ejemplo reciente que ha generado debate es el caso de una modelo webcam que supuestamente fue suplantada por una inteligencia artificial mediante la técnica conocida como «deepfake». Esta tecnología permite crear videos falsos muy convincentes utilizando algoritmos de aprendizaje automático para manipular imágenes y audio de manera realista. Si bien el uso de deepfakes con fines maliciosos es motivo de preocupación, también plantea cuestiones más profundas sobre la autenticidad y la confianza en la era digital.

La modelo, manifestó qué: ““Les dijeron a mis usuarios que el estudio con el que trabajaba me había echado y que yo necesitaba una ayuda económica. Mis tippers aceptaron tener una conversación supuestamente conmigo por Zoom. En esta plataforma es que los terminan engañando”.

Este no ha sido el único caso, pues se han conocido suplantaciones como la de Taylor Swift, el presidente ucraniano Zelensky, Mark Zuckerberg, entre otros.

La proliferación de deepfakes no solo plantea desafíos en el ámbito de la privacidad y la seguridad, sino que también socava la confianza en la información y la veracidad de lo que vemos y escuchamos en línea. En un mundo donde la desinformación y las noticias falsas ya son una preocupación creciente, la capacidad de generar contenido manipulado con facilidad plantea serias amenazas para la democracia y la sociedad en su conjunto.

Además de los riesgos asociados con el uso indebido de la tecnología, la IA también plantea preocupaciones éticas en términos de sesgo algorítmico y discriminación. Los algoritmos de IA, alimentados por grandes cantidades de datos, pueden perpetuar y amplificar prejuicios existentes, lo que lleva a decisiones injustas y discriminatorias en áreas críticas como el empleo, la justicia penal y la atención médica. A menos que abordemos activamente estos problemas, corremos el riesgo de perpetuar y amplificar las desigualdades sociales y sistémicas en nuestra sociedad.

Estos casos de suplantación de identidad deben ser revisados por las autoridades competentes, lo que hace necesario aplicar una regulación efectiva, donde se tenga en cuenta:

Un marco legal internacional: implica la creación de leyes y regulaciones a nivel global que aborden específicamente el uso de la IA y tecnologías relacionadas. Este marco legal garantizaría la consistencia y coherencia en la aplicación de normativas en diferentes países, lo que ayudaría a prevenir el abuso de la IA y a proteger los derechos de las personas en todo el mundo.

Agencias reguladoras especializadas: estas agencias serían responsables de supervisar y regular el desarrollo, la implementación y el uso de la IA dentro de un país o región específica. Estas entidades tendrían el conocimiento y la experiencia necesarios para evaluar los riesgos y establecer estándares para garantizar que la IA se utilice de manera ética y responsable.

Certificación de sistemas de IA: esta medida implica la implementación de procesos de certificación para los sistemas de IA, similares a los estándares de calidad utilizados en otras industrias. Estas certificaciones garantizarían que los sistemas de IA cumplan con ciertos criterios éticos, de seguridad y de privacidad antes de ser utilizados en aplicaciones del mundo real

Evaluación del riesgo y el impacto social de la IA: antes de implementar cualquier sistema de IA, es fundamental realizar una evaluación exhaustiva de los posibles riesgos y impactos sociales. Esto implica considerar cómo la IA podría afectar a diferentes grupos de personas, así como identificar y mitigar cualquier riesgo potencial de discriminación, sesgo u otros efectos negativos.

Participación del Estado y la sociedad: es crucial que tanto el Gobierno como la sociedad civil participen activamente en el proceso de regulación y supervisión de la IA. Esto garantizaría que las políticas y regulaciones sean inclusivas, equitativas y representativas de los valores y preocupaciones de la sociedad en su conjunto.

En este sentido, es un esfuerzo que requiere la participación de varios actores como: los usuarios, los y las modelos, los empresarios, las entidades públicas y privadas. Todos tenemos un papel que desempeñar en la configuración del futuro de la inteligencia artificial en Colombia.